Stuart A. Thompson

A Meta gostaria de apresentar seu próximo checador de fatos —aquele que identificará falsidades, escreverá correções convincentes e alertará os outros sobre conteúdos enganosos.

É você.

Mark Zuckerberg, CEO da Meta, anunciou na terça-feira (7) que estava encerrando grande parte dos esforços de moderação da empresa, como a verificação por terceiros e restrições de conteúdo.

Em vez disso, ele disse que a empresa transferirá as responsabilidades de verificação de fatos para os usuários comuns sob um modelo chamado Community Notes (notas de contexto), que foi popularizado pelo X (antigo Twitter) e permite que os usuários deixem uma checagem de informação ou correção em uma postagem de mídia social.

O anúncio sinaliza o fim de uma era na moderação de conteúdo e uma aceitação de diretrizes mais flexíveis que até mesmo Zuckerberg reconheceu que aumentariam a quantidade de conteúdo falso e enganoso na maior rede social do mundo.

"Acho que vai ser um fracasso espetacular", disse Alex Mahadevan, diretor de um programa de alfabetização midiática no Instituto Poynter chamado MediaWise, que estudou o Community Notes no X. "A plataforma agora não tem responsabilidade por realmente nada do que é dito. Eles podem transferir a responsabilidade para os próprios usuários."

Tal mudança teria sido inimaginável após as eleições presidenciais de 2016 ou mesmo 2020, quando as empresas de mídia social se viam como guerreiros relutantes na linha de frente de uma guerra de desinformação. Falsidades generalizadas durante a eleição presidencial de 2016 desencadearam uma reação pública e um debate interno nas empresas de mídia social sobre seu papel na disseminação das chamadas fake news.

As empresas responderam investindo milhões em esforços de moderação de conteúdo, pagando verificadores de fatos terceirizados, criando algoritmos complexos para restringir conteúdo tóxico e lançando uma enxurrada de rótulos de aviso para desacelerar a propagação de falsidades —medidas vistas como necessárias para restaurar a confiança pública.

Os esforços funcionaram, até certo ponto —rótulos de verificação de fatos foram eficazes em reduzir a crença em falsidades, descobriram os pesquisadores, embora fossem menos eficazes entre os norte-americanos conservadores.

Mas os esforços também transformaram as plataformas —e Zuckerberg em particular— em alvos políticos do então presidente eleito Donald Trump e seus aliados, que disseram que a moderação de conteúdo era nada menos que censura.

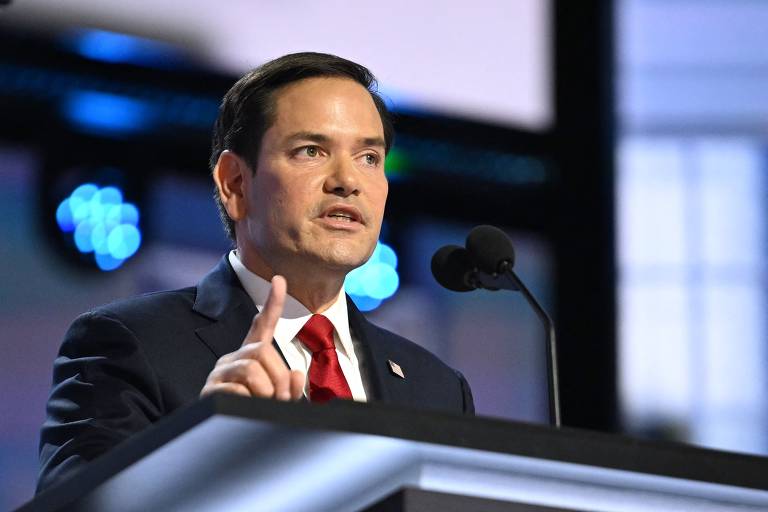

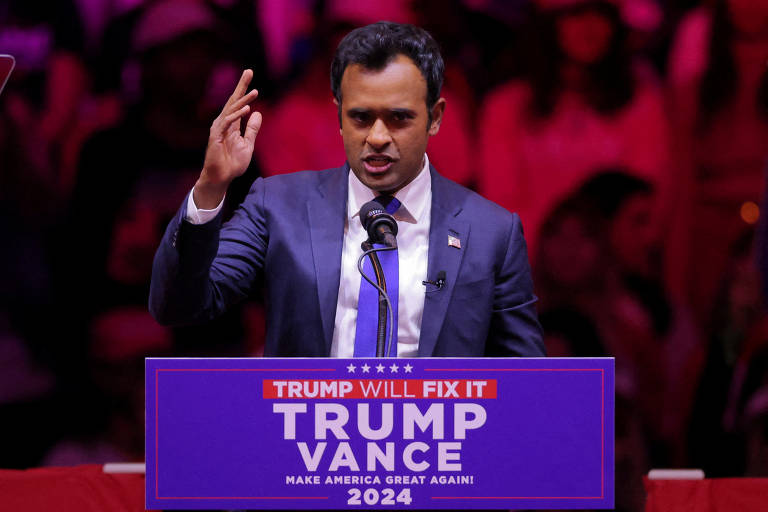

Agora, o ambiente político mudou. Com Trump prestes a assumir o controle da Casa Branca e dos órgãos reguladores que supervisionam a Meta, Zuckerberg mudou para reparar seu relacionamento com Trump, jantando em Mar-a-Lago, adicionando um aliado de Trump ao conselho de diretores da Meta e doando US$ 1 milhão para o fundo de inauguração de Trump.

"As eleições recentes também parecem um ponto de inflexão cultural para mais uma vez priorizar a liberdade de expressão", disse Zuckerberg em um vídeo anunciando as mudanças na moderação.

A aposta de Zuckerberg em usar o Community Notes para substituir profissionais que checam os fatos foi inspirada por um experimento semelhante no X que permitiu a Elon Musk, seu proprietário bilionário, terceirizar a verificação de fatos da empresa para os usuários.

O X agora pede aos usuários comuns que identifiquem falsidades e escrevam correções ou adicionem informações extras às postagens de mídia social. Os detalhes exatos do programa da Meta não são conhecidos, mas no X, as notas são inicialmente visíveis apenas para usuários que se registram no programa Community Notes. Uma vez que uma nota recebe votos suficientes considerando-a valiosa, ela é anexada à postagem de mídia social para que todos possam ver.

"O sonho de uma plataforma de mídia social é uma moderação completamente automatizada que, primeiro, eles não têm que assumir responsabilidade e, segundo, não têm que pagar ninguém por isso", disse Mahadevan. "Então, o Community Notes é o sonho absoluto dessas pessoas —eles basicamente tentaram criar um sistema que automatizaria a verificação de fatos."